Любители азартных развлечений на Апрель 2024 предпочитают играть на сайте казино исключительно на деньги. Это связано с большими шансами на выигрыш.

В сети насчитывается больше 20 легальных игровых заведений. Однако сайт Азино Три 7 пользуется наибольшей популярностью. Во многом это связано с качественной программой лояльностью, обилием слот-машин и стабильными выплатами. Для ставок на реал требуется регистрация с последующим пополнением счета.

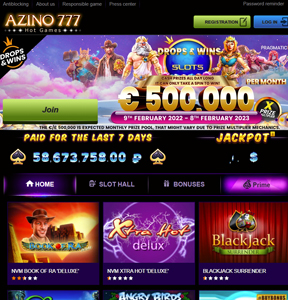

💻 Сайт игровых автоматов Азино777

К сожалению, законодательство многих стран устанавливает запрет на ведение бизнеса в сфере онлайн гемблинга. Чтобы выполнить на Азино777 официальный сайт вход через телефон или ПК, требуется зеркало. В любом случае деятельность контролируется PGCB и другими службами. Все это указывает на честность и открытость со стороны платформы.

Зеркало casino Азино 777 является главным инструментом среди игроков для запуска игр на деньги.

Рабочая копия ничем не отличается от главной страницы. При отсутствии доступа к слотам, на помощь может прийти рабочее зеркало, гарантирующее комфорт и удобства. В считанные минуты открывается возможность возобновить ставки на деньги.

Какие автоматы доступны в Azino777?

Эксперты проанализировали отзывы игроков и пришли к выводу, что отыскать сайт Азино 777 несложно. На это понадобиться минимум времени.

Основная площадка содержит все инструменты для продуктивного гэмблинга.

- круглосуточный доступ к лицензированным слотам;

- высокий коэффициент отдачи;

- начисление бонусов на день рождения и промокодов;

- широкий выбор платежных инструментов;

- регулярные турниры и акции.

Чтобы удостовериться в этом самостоятельно, достаточно пройти по актуальному адресу. Сразу после этого официальный сайт казино сделает все, чтобы обеспечить комфортные условия для клиентов. Если нет доступа – используйте зеркало.

Виртуальный клуб отличается расширенным перечнем инструментов для выполнения финансовых операций. Клиенты казино Azino777 самостоятельно определяют платежную систему, учитывая персональные потребности.

📝 Информация о казино Азино777

За внесение депозита комиссия не удерживается в казино, что позволяет говорить о максимальной выгоде.| Обзор официального сайта | Особенности |

|---|---|

| Саппорт | Онлайн чат |

| Слоты | >800 |

| Вывод | 8+ способов |

| Интерфейс | Русский |

| Доступ | Приложение, браузер |

Анализируя отзывы игроков можно сделать вывод, что азартное заведение не обманывает. Более того, Azino777 Три Топора официальный сайт обладает лицензией Гибралтар, поэтому чтит международные нормы в области онлайн гемблинга. При необходимости специалисты саппорта готовы предоставить скан документов.

Пользователям не рекомендуется игнорировать правила игры.

Администрация площадки работает честно — имеется вся необходимая документация.

За все время работы, казино не было замечено в махинациях. Чтобы быстро выводить деньги со счета, нужно пройти верификацию. Требование стандартное для всех и предполагает предоставление скана паспорта на проверку.

👨💻 Оригинальный сайт Azino777 три топора

Наличие аккаунта является для игроков обязательным, если планируются игры на деньги. Не требуется личный кабинет при условии ставок в демо-режиме. В таком случае достаточно активации неоплачиваемой версии выбранного слота. Это предполагает следующие особенности:

- выигрыш остается в собственности казино;

- неограниченные ставки на слотах;

- автоматическое восстановление монет;

- бонусы и турниры недоступны;

- безрисковая игра в азартных играх позволяет разработать тактику.

Постоянные клиенты площадки не советуют долго спинить в демо.

Делая выбор в пользу проверенных игровых автоматов с высокой отдачей, гарантируются стабильные выигрыши.

Широкий каталог предложений часто вызывает сложности у новичков. Но в личном кабинете есть фильтр поиска, позволяющий выполнить сортировку. Рекомендуется отбирать по жанру, RTP, бонусным раундам.

Главное преимущество площадки заключается в многофункциональности.

🎲 Игры на деньги в Азино777

Помимо стандартных опций, сайт azino777 позволяет клиентам создавать собственный рейтинг слотов, добавляя в избранные. Это позволяет исключить поиски автомата при каждом входе.| Популярные игровые автоматы | RTP | Max множитель | Рейтинг |

|---|---|---|---|

| Dolphine’s | 96.67% | X3500 | 9/10 |

| Pirate | 97.09% | X4530 | 10/10 |

| Gnome | 95.55% | X7650 | 7/10 |

| Gladiator | 96.89% | X7150 | 8/10 |

| Mines | 97.31% | X1540 | 7/10 |

Каждый аппарат оснащен бонусами. К примеру, сайт Азино777 позволяет удвоить выигрыш или получить бесплатные вращения на некоторых слот-машинах. Они не предусматривают вейджер, поэтому сразу доступны к выводу.

На официальном портале онлайн казино можно играть не только в видеослоты, но также в покер с живыми дилерами.

Чтобы обеспечить максимальный комфорт, важно позаботиться о беспрепятственной авторизации и финансовых операциях. Запуская выигрышные игровые автоматы азино777 моментальные выплаты гарантируются каждому посетителю, прошедшему верификацию. Транзакции выполняются от 1 до 3-х дней.

Площадка стремительно набирает популярности. Поэтому неудивительно, что она входит в топ казино по многим параметрам. Во многом это заслуга администрации и разработчиков.

Как войти в клуб Азино777 с телефона?

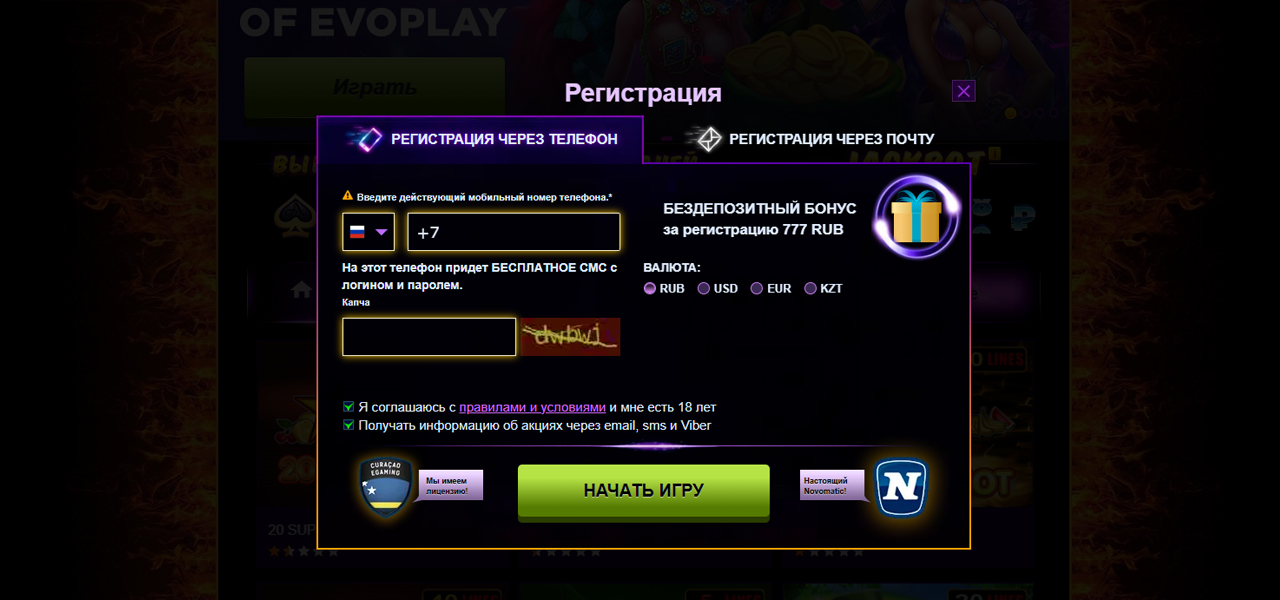

Регистрация необходима для ставок на реальные деньги и получения многочисленных бонусов. Предусматривается несколько этапов.

Перейдите на главную страницу казино и нажмите клавишу регистрации.

Заполните регистрационную форму персональными данными, внесите депозит и получите бонус 777 рублей на счет.

Перейдите в игровой зал, подберите аппарат и начните играть с бонусами.

- Работа по международной лицензии

- Понятный интерфейс и четкие правила

- Обилие платежных систем

- Щедрые игры с разной тематикой

- Качественный софт для смартфонов

- Постоянные блокировки со стороны Роскомнадзора

- Требуется поиск зеркала для обхода ограничений

Наши эксперты уверены в том, что обзор online казино позволил определить его функционал и подтвердил честность. Поэтому стоит переходить на площадку и играть. Мошенничество со стороны администрации исключено.

По желанию пользователей можно ознакомиться с обзорами других клубов, которые также предоставляют доступ к играм на реал.